数据中心的热与冷 人工智能公共数据专题七中的关键细分

在人工智能(AI)蓬勃发展的浪潮中,公共数据的价值日益凸显。作为本系列专题的第七篇,我们将聚焦于一个常被忽视却至关重要的技术细分领域:数据中心的热管理与冷却。这不仅是一个工程问题,更是确保AI公共数据可用性、安全性与可持续性的基石。

一、热:AI算力与数据密集的必然产物

人工智能,特别是大模型训练与推理,是极其耗能的计算过程。处理海量公共数据时,成千上万的服务器集群满负荷运行,产生惊人的热量。这种“热”是AI数据处理强度的直接体现。若不加控制,过热将导致硬件性能下降、可靠性降低甚至永久损坏,直接威胁到公共数据服务的连续性与完整性。因此,“热”成为了数据中心必须直面和管理的核心挑战。

二、冷:保障数据生命线的关键技术

“冷”并非目的,而是维持数据中心稳定运行的必要手段。高效的冷却系统是确保服务器在适宜温度下处理公共数据的关键。传统的风冷技术已难以满足高密度AI计算的需求,液冷(包括冷板式和浸没式)等先进技术正成为趋势。这些技术能更高效地带走热量,显著降低能耗(PUE值),为处理大规模公共数据提供更稳定、更节能的环境。对“冷”的追求,本质是对数据计算效率与运营成本的优化。

三、为何此细分必须重视?

- 数据可用性的根基:公共数据服务于政府决策、科研与社会创新。数据中心的热失控可能导致服务中断,影响数据获取与分析,动摇AI应用的信任基础。

- 能源与可持续发展的关键:数据中心的能耗巨大,其中冷却系统占比可观。优化冷却就是直接降低AI产业的整体碳足迹,符合全球绿色计算趋势,对于依赖公共数据的长期AI项目至关重要。

- 经济性的核心:电费是数据中心主要运营成本。高效的冷却方案能大幅降低PUE,直接节约开支,使得管理和开放公共数据的成本更可控,促进更广泛的数据共享与利用。

- 技术创新的前沿:热管理创新(如AI驱动的动态冷却、余热回收利用)本身就是AI与工程融合的典范。解决此问题能反哺更强大的计算基础设施,形成良性循环。

四、面向AI公共数据未来的思考

在规划与建设用于承载AI公共数据的数据中心时,必须将热管理与冷却从“配套工程”提升到“核心架构”层面进行设计。这包括:

- 前瞻性设计:根据公共数据增长与AI算力需求预测,预留冷却容量并采用模块化、可扩展的冷却方案。

- 智能化运维:利用AI算法实时监测数据流与热负荷,动态调整冷却策略,实现精准降温。

- 绿色化协同:探索将数据中心余热用于区域供热等循环经济模式,提升公共数据基础设施的社会综合效益。

数据中心“热”与“冷”的博弈,是支撑AI时代公共数据价值释放的隐形战场。忽视这一细分,就如同建造了一座藏书丰富却防火堪忧的图书馆。唯有重视并持续优化热管理,我们才能确保承载人类知识与智慧的公共数据,在AI的驱动下安全、高效、可持续地服务于社会进步。

最新产品

大数据的四大宏观趋势与人工智能公共数据的协同演进

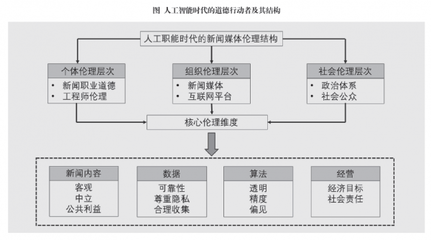

人工智能时代的新闻伦理 公共数据驱动下的行动与治理框架

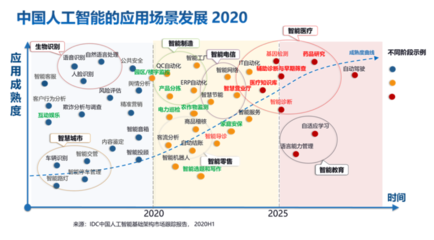

《2020年中国AI算力报告》揭示 人工智能公共数据与算力基建是未来发展关键

人工智能公共数据 图数据库在清华大学2020精品报告中的角色与价值

软杰荣膺2019深圳安博会无感支付十大品牌,以人工智能驱动公共数据创新

城云科技闪耀杭州智博会,人工智能公共数据创新获潘云鹤院士高度认可

纳斯达克CIO 人工智能与公共数据驱动的云原生架构

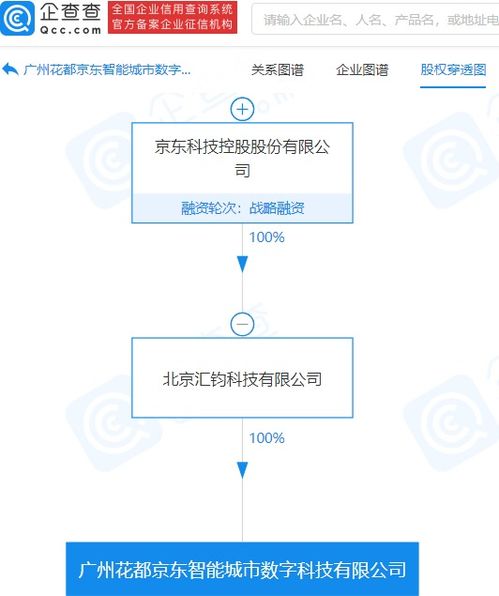

京东布局智慧城市 投资成立人工智能公共数据科技公司,推动城市数字化新篇章

新零售浪潮下,e公里末端公共配送站的AI数据化变革与创新

推波助澜 人工智能与公共数据共筑时代智能新篇章